Lutte à la désinformation

Le rôle de nos biais cognitifs

Chiens ou chats ? Peu importe...

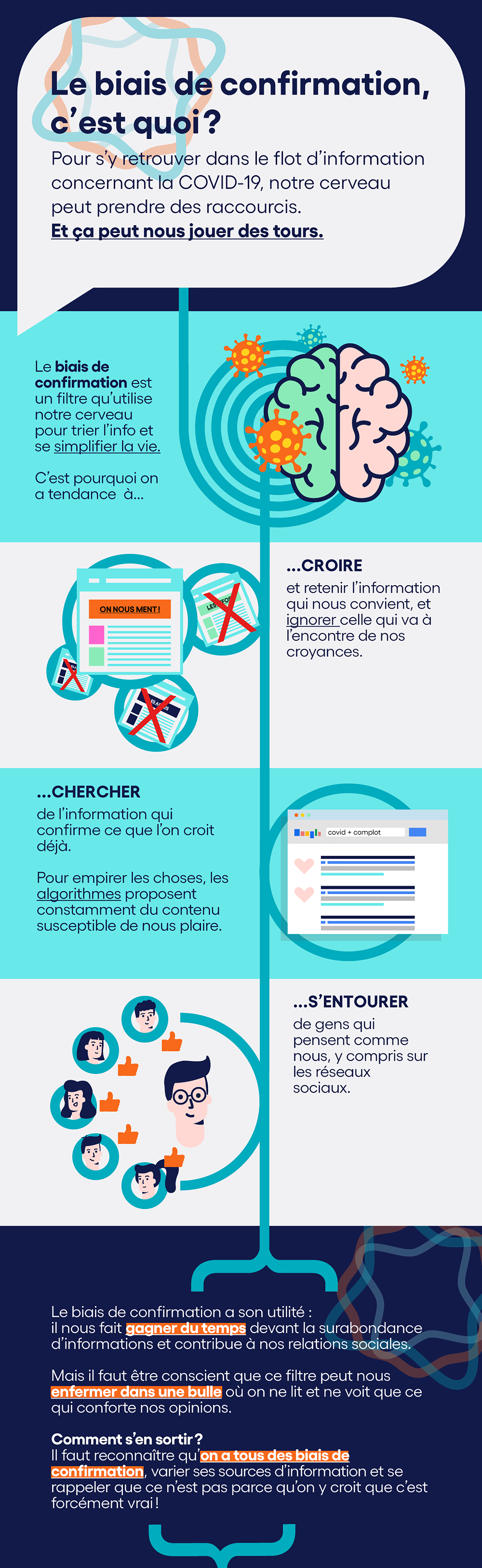

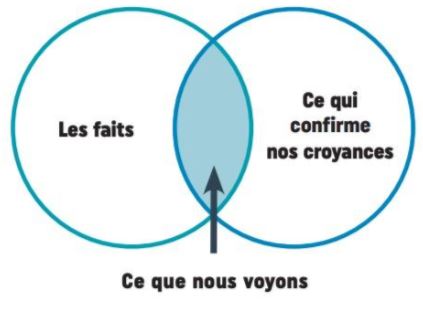

Biais de confirmation

Plus sur le biais de confirmation

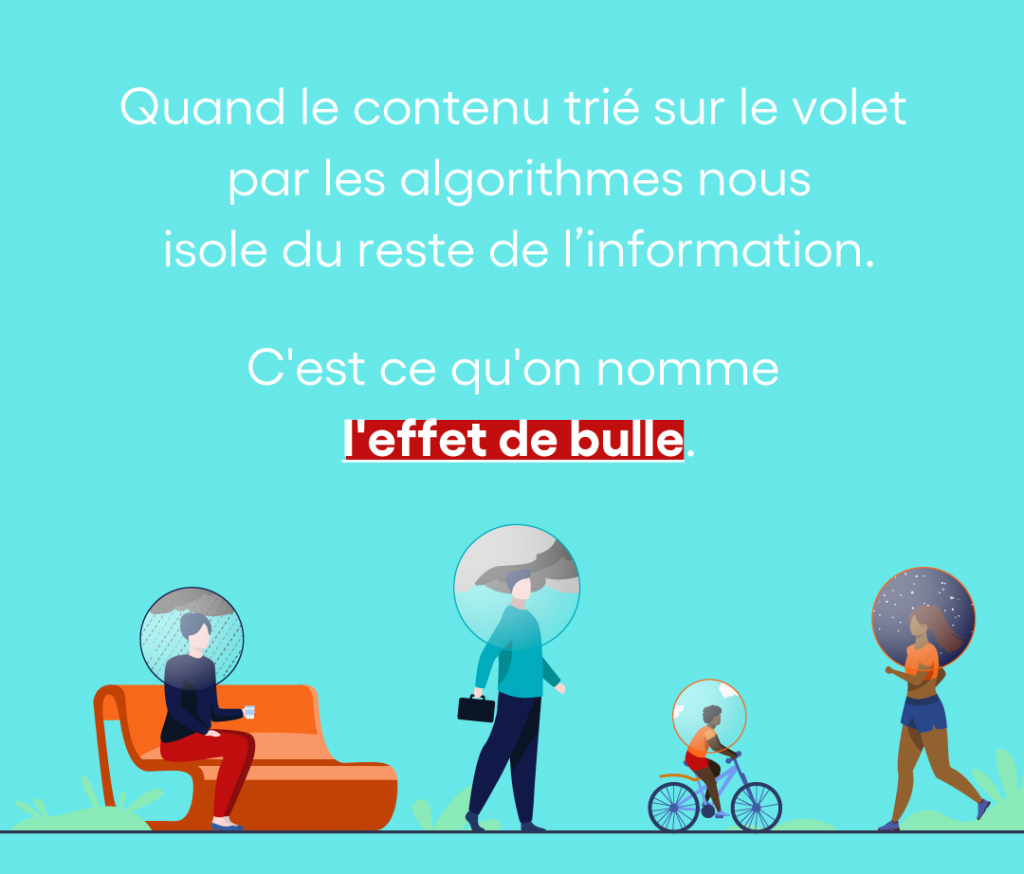

Leurs créateurs savent que, sur les réseaux sociaux, on est davantage exposé à des informations qui nous plaisent.

L’effet de bulle et les algorithmes

Dans la vraie vie, comme sur les réseaux sociaux, on a tendance à s’entourer de gens qui pensent comme nous, avec pour résultat qu’on se retrouve dans une bulle informationnelle où tout le monde partage les mêmes informations…

Graduellement, on finit par ne plus être exposé qu’à une information uniforme sur certains sujets.

Grâce à nos données personnelles et à nos interactions avec les publications, les algorithmes des réseaux sociaux nous présentent du contenu qui correspond à nos goûts, nos intérêts et nos croyances, tout en excluant le reste.

C’est une façon de nous garder captifs de cet univers personnalisé et confortable… et de nous exposer à de la publicité ciblée.

Les autres raccourcis mentaux

Plusieurs autres de nos biais cognitifs participent à la propagation des fausses nouvelles et de la désinformation.

Parmi ces autres raccourcis mentaux, il y a notamment :

- Le biais de popularité

- Le biais émotionnel

- L’effet de halo

Le biais de popularité

Pour aller plus loin

L’effet de halo

Comment faire alors pour éviter d'emprunter des raccourcis mentaux?

Le Détecteur de rumeurs vous propose ces quelques pistes

1 – Il faut d’abord reconnaître que nous avons tous des biais cognitifs.

2 – Douter, douter, douter… même quand l’information semble en accord avec nos croyances.

3 – Consulter des médias dont on n’est pas nécessairement d’accord avec la ligne éditoriale.

En conclusion

Pour aller encore plus loin

Inscrivez-vous à un de nos ateliers de formation!

Lutte aux fausses nouvelles : un enjeu de société

Continuez vers les autres parcours thématiques!

Abonnez-vous à notre infolettre!